Áttekintés

Az előző ismereteink alapján a CUDA-ban a GPU kód párhuzaomsan több szálon futtatott programot jelent. A korábbi kód viszont még csak egyetlen szálon végzett egy összeadást. Nézzünk meg egy olyan kódrészletet, amely már több szálon fut.

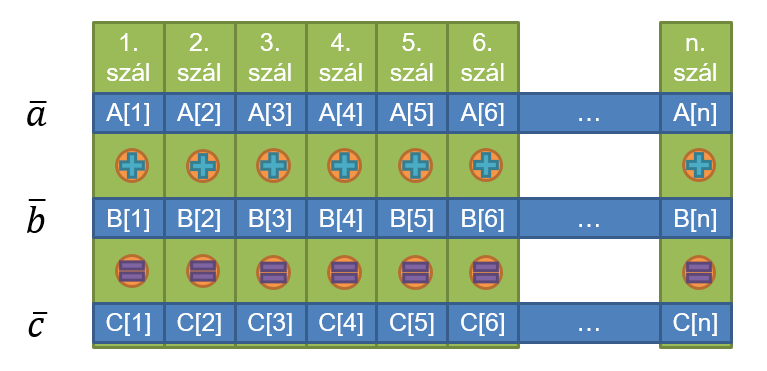

A feladata mit elvégzünk ebben az esetben egy vektor összeadás. Tegyük fel, hogy adott két vektor a és b a feladat hogy számítsuk ki a két vektor

c = a + b

összegét. Mivel a három vektor mérete megegyezik a feladatot elvégezhetjük elemenként úgy, hogy minden elempár összeadására egy-egy szálat indítunk, ahogy a következő ábrán is látható.

A kernel indításakor tehát annyi elemet szálat kell indítani, ahány elempár van.

A megoldás teljes kódja Letölthető innen.